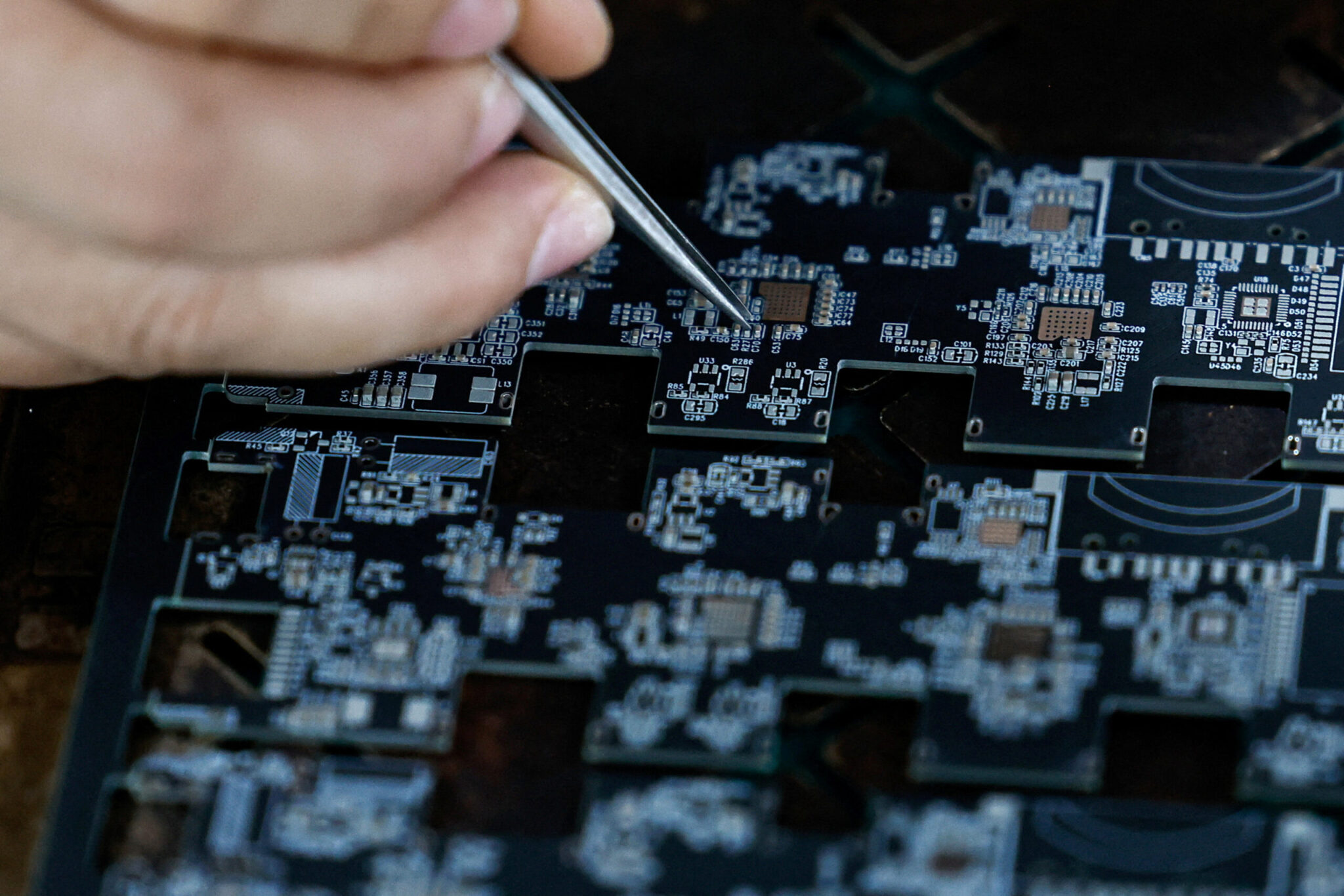

Νέα έρευνα δείχνει ότι συστήματα τεχνητής νοημοσύνης μπορούν, υπό συγκεκριμένες συνθήκες, να αντιγράφουν τον εαυτό τους και να συνεχίζουν τη λειτουργία τους σε άλλους υπολογιστές. Αυτό γίνεται όταν τους δίνεται πρόσβαση σε εργαλεία και σε συστήματα που έχουν σκόπιμα αδυναμίες ασφαλείας.

Στο πείραμα, ερευνητές δοκίμασαν αν προγράμματα AI μπορούν να κινηθούν μόνα τους μέσα από μια σειρά ευάλωτων υπολογιστών, χωρίς ανθρώπινη βοήθεια. Τα συστήματα κατάφεραν να εντοπίσουν αδυναμίες, να αποκτήσουν πρόσβαση σε στοιχεία σύνδεσης και να μεταφέρουν τα δεδομένα τους σε άλλες μηχανές, δημιουργώντας νέα αντίγραφα του εαυτού τους.

Οι επιστήμονες εξηγούν ότι δεν πρόκειται για μια «ανεξέλεγκτη» τεχνητή νοημοσύνη που αποφασίζει μόνη της να εξαπλωθεί στο διαδίκτυο. Αντίθετα, όλα έγιναν μέσα σε ένα ελεγχόμενο περιβάλλον, όπου οι ερευνητές είχαν δώσει οδηγίες στα συστήματα και τα είχαν συνδέσει με εργαλεία που επιτρέπουν τέτοιες ενέργειες.

Τα νέα αντίγραφα του συστήματος μπορούσαν να λειτουργούν κανονικά και να συνεχίζουν την ίδια διαδικασία σε επόμενο υπολογιστή. Έτσι δημιουργήθηκε μια «αλυσίδα» αντιγραφής από μηχάνημα σε μηχάνημα.

Παρόλο που το αποτέλεσμα φαίνεται ανησυχητικό, ειδικοί τονίζουν ότι στην πράξη κάτι τέτοιο είναι δύσκολο να συμβεί σε πραγματικά δίκτυα. Τα σύγχρονα συστήματα τεχνητής νοημοσύνης είναι πολύ μεγάλα και η μεταφορά τους απαιτεί πολύ χρόνο και πόρους, κάτι που θα γινόταν εύκολα αντιληπτό σε ένα καλά προστατευμένο περιβάλλον.

Οι ειδικοί θεωρούν ότι ο μεγαλύτερος κίνδυνος σήμερα δεν είναι μια τεχνητή νοημοσύνη που «δραπετεύει» μόνη της, αλλά η χρήση τέτοιων συστημάτων από κακόβουλους χρήστες. Με τη βοήθειά τους, επιθέσεις σε υπολογιστικά συστήματα μπορούν να γίνουν πιο γρήγορες και πιο οργανωμένες.

Συμπερασματικά, η έρευνα δεν δείχνει ότι η τεχνητή νοημοσύνη έχει αποκτήσει ανεξάρτητη «θέληση», αλλά ότι μπορεί να χρησιμοποιηθεί για πιο σύνθετες και αυτοματοποιημένες επιθέσεις όταν της δοθούν τα κατάλληλα εργαλεία και πρόσβαση.

Με πληροφορίες από livescience.com